一个气泡水广告,为何几十万人围观?原来整个都是Veo 3生成的

仅用于站内搜索,没有排版格式,具体信息请跳转上方微信公众号内链接

机器之心报道

机器之心编辑部

最近,一个完全由AI制作的广告在社交媒体上爆火,在X上有三十多万人观看。

这是一个叫TooShortforModeling的团队发布在LinkedIn上的作品,不过它并不是一个商业作品,而是该团队为一直想合作的品牌制作的概念影片。

距离Veo3发布已经过去一个半月了,虽然此前模型视频生成已经能达到很逼真的状态,但Veo3的「音画同步」功能,引领AI视频创作进入了全新的声画一体化阶段。同时它也让AI视频生成进入了更有实践意义的阶段,极大地降低了视频创作的门槛。

我们先来看看这个广告效果怎么样。

人物1:下午好,小伙子。(Goodafternoon,son.)

人物2:想猜猜我为什么让你靠边停车吗?(WannatakeaguesswhyIpulledyouover?)

人物1:哦,不是你想的那样。(Oh,it’snotwhatyouthink.)

人物1:这是“液态死亡”。是苏打山泉水。(It’sliquiddeath. They’resparklingmountainwater.)

人物2:嗯。哇。你没开玩笑。(Mmm. Wow.Youweren’tkidding.)

人物2:确实很清爽。(Thatisrefreshing.)

人物2:但这不是我让你靠边停车的原因。(Butit’snotwhyIpulledyouover.)

人物1:哦,天哪。(Ohboy.)

人物1:是因为破损的尾灯吗?(Isitthebustedtaillight?)

人物2:不是。(Uh-uh.)

人物1:是因为车牌吗?(Isitbecauseofthelicenseplate?)

人物2:不是。(Nope.)

人物1:该死,伙计。是那个死人,对吧?(Shit,man. It’sthedeadguy,right?)

人物2:不,先生。(No,sir.)

人物1:也许是人口贩卖?(Isitthehumantrafficking,perhaps?)

人物2:不是。(Uh-uh.)

人物1:伙计,是卡车的事吗?(Man,isitthetruckthing?)

人物2:我不这么认为。(Idon’tthinkso.)

人物1:好吧,那到底是什么?(Well,whatisitthen?)

人物1:抢劫案?(Therobbery?)

人物2:不。(No.)

人物1:是保险杠贴纸?(Thebumpersticker?)

人物2:不。(No.)

人物1:是被车撞死的动物,对不对?(It’stheroadkill,isn’tit?)

人物2:没听说过。(Haven’theardofit.)

人物1:是化学废料?(Thechemicalwaste?)

人物2:不是。(Uh-uh.)

人物1:是过山车座位吗?(Isittherollercoasterseat?)

人物1:是邪教的事吗?(Isitthecultthing?)

人物2:绝对不是。当然不。(Absolutelynot. Hellno.)

人物1:好吧,我放弃了。(Allright,Igiveup.)

人物1:到底是什么?(Whatisit?)

人物2:因为今天是你的生日。(It’sbecauseit’syourbirthday.)

人物2:生日快乐,凯文。(Happybirthday,Kevin.)

人物1:爸爸,你还记得。(Dad,youremembered.)

人物2:祝你生日快乐,祝你生日快乐,祝你生日快乐。(Happybirthdaytoyou,HappyBirthdaytoyou,HappyBirthdaytoyou.)

视频字幕,上下滑动查看。

这个广告的笑点密集,令人捧腹。但其真正的亮点在于惊人的「角色一致性」。在一分钟内,视频流畅地切换了10个场景,每个画面的风格都保持了高度统一,核心人物和道具也完美衔接。尽管在车窗、内饰等细节上能察觉到微小的跳跃,但这丝毫未影响其出色的整体连贯性。

要知道AI生成视频中经常出现容貌突变、物体错乱等问题。

主创团队分享了他们保持一致性的秘诀——超精细提示(Hyper-specificPrompting):为模型提供极其详尽、具体且包含大量上下文细节的指令或问题。

这种提示的设计目的是为了最大限度地减少模型的自由发挥空间,引导它生成高度精确、符合特定格式和要求的输出。

相关的提示词优化方法,在我们之前的文章中也提到过,读者可以参考:实测惊艳全球的Veo3!音画同步无敌,贵是有原因的

值得一提的是,创意、策略与审美依然由人类主导。从最初的灵感、脚本,到由剪辑师完成的最终效果呈现,人的价值贯穿始终。AI是强大的「执行者」,但遵循的是概率而非远见——至少在今天,这道边界依然清晰。

AI为何总在细节上「翻车」?

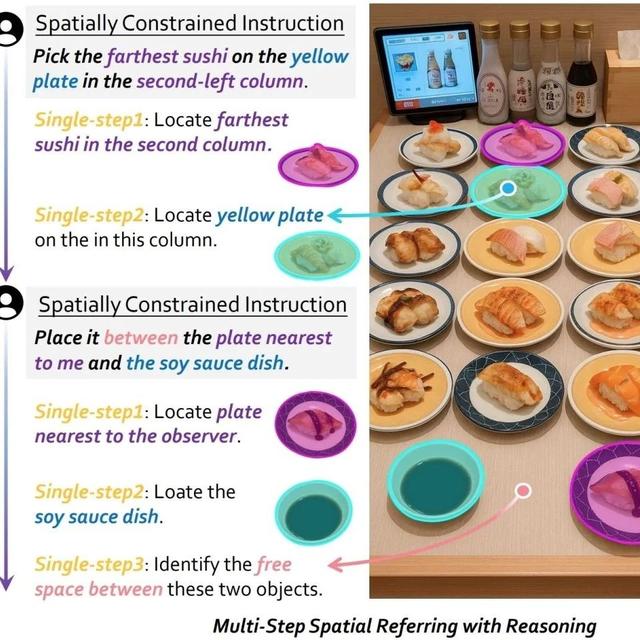

关于「角色一致性」的问题,技术层面来讲,并非模型「犯了糊涂」,而是主流视频生成模型背后的核心技术——扩散模型本身的工作原理、训练数据以及从图像到视频的技术跨越之中,主要是以下几点原因:

模型没有「理解」世界,只有「概率统计」:模型并非真正理解「人有五根手指」这类事实,而是通过学习海量数据,知道「五指的手」是最高概率的模式。当生成过程中出现随机偏差时,由于缺乏常识性规则的约束,它可能会生成一个概率上虽低但仍有可能的「六指」结果。

局部生成与全局和谐的矛盾:模型更擅长生成逼真的局部细节(如皮肤纹理),但对整体结构(如完整的身体解剖)的把握较弱。它可能会因为专注于让局部「看起来对」,而忽略了其在整体画面中的逻辑是否合理,导致「只见树木,不见森林」的结构性错误。

从图像到视频的挑战:视频的本质是连续的图像序列,而模型在生成每一帧时都可能存在微小的随机差异。这种帧与帧之间的「失忆」累积起来,就会导致角色外观、服饰或背景等元素在时间线上发生不连贯的漂移和变化,破坏了时间一致性。

训练数据的「不完美」:模型的知识完全来源于它所学习的训练数据。网络数据本身就包含大量错误、低质量和不合逻辑的内容。模型会将这些「坏数据」也一并学会,并在生成时复现出来,可谓「垃圾进,垃圾出」。

探索AI的创意玩法

当前,大量猎奇、同质化的AI视频内容,正是AI技术被「降维使用」的体现。真正值得我们探索的,是AI作为「创意催化剂」的巨大潜力。

下面这些会不会是AI的正确打开方式?

为你喜欢的电影制作一个平行宇宙。

让初音未来进入老头环的世界,会不会是下一个爆款游戏的灵感?

为公司做一个网站。

或者做一个超炫酷的概念影片。

你觉得AI还能为我们的创意带来什么惊喜?欢迎在评论区留下你的脑洞。

©THEEND

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin. com