医疗AI开发新起点:谷歌发布多模态模型MedGemma 27B、轻量级编码器MedSigLIP,附技术报告

仅用于站内搜索,没有排版格式,具体信息请跳转上方微信公众号内链接

将ScienceAI设为星标

第一时间掌握

新鲜的AIforScience资讯

编辑丨coisini

人工智能(AI)在医疗健康领域具有巨大应用潜力,但由于医疗数据多样、医疗任务复杂、隐私保护要求高,模型的训练与部署面临挑战。

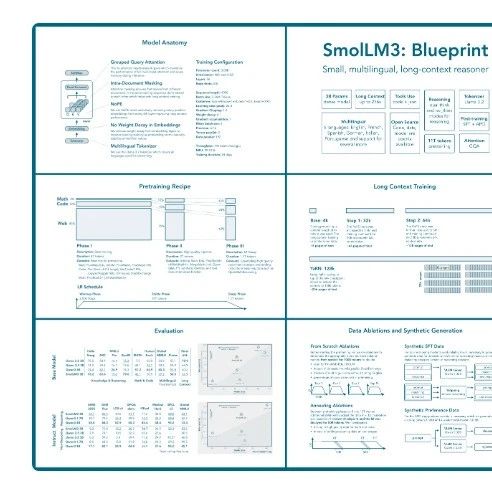

基于这些问题,谷歌面向健康医疗研究及应用构建了HAI-DEF——一个包含一系列轻量级开源模型的集合。今年5月,谷歌基于Gemma3架构又开发了生成式模型MedGemma,进一步扩展了HAI-DEF。

现在,谷歌发布MedGemma技术报告,并推出两款新模型:多模态模型MedGemma27B、轻量级图文编码器MedSigLIP。

技术报告:https ://www. alphaxiv.org/abs/2507. 05201

模型地址:https ://deepmind. google/models/gemma/medgemma/

MedGemma:面向健康领域的多模态生成模型

MedGemma系列包含4B和27B两种规模的模型变体,现均已支持图像与文本的多模态输入,并生成文本输出。

MedGemma4B在MedQA医学问答基准测试中取得64. 4%的准确率,位列超小型开源模型(<80亿参数)第一梯队。

在一项非盲实验中,美国执业放射科医师评估认为:MedGemma4B生成的胸部X光报告中,81%在诊断准确性上达到与原始放射科报告相近的临床处理建议水平。

此外,MedGemma4B在医学影像分类任务中的表现可媲美顶尖专用模型。

MedGemma27B纯文本版在MedQA基准上取得了87. 7%的准确率,与DeepSeekR1仅差3个百分点,而推理成本仅为其十分之一。

而MedGemma27B多模态版,通过新增对复杂多模态数据及纵向电子健康记录(EHR)解析的支持,与4B多模态版和27B纯文本版形成功能互补。

MedGemma基于Gemma3架构,采用医学数据进行训练。在开发过程中,研究团队注重保留Gemma模型的通用能力,这使得MedGemma能够:

出色处理医学与非医学信息混合的任务

保持多语言指令跟随能力

在非英语语境中维持性能

MedGemma的一个关键特性是其出色的适应能力,开发者能直接提升目标应用的性能表现。这凸显了MedGemma作为医疗AI开发起点的价值。

MedSigLIP:专为医疗打造的图像编码器

MedSigLIP是一个仅含4亿参数的轻量级图像编码器,采用基于Sigmoid损失的视觉语言预训练架构(SigLIP)。

研究团队通过对胸部X光片、组织病理切片、皮肤病图像及眼底影像等多样化医学影像数据进行调优,使MedSigLIP能捕捉不同模态特有的细微特征。

MedSigLIP特别适用于:

传统图像分类:构建高性能医学影像分类模型

零样本图像分类:实现无需特定训练样本的分类

语义图像检索:从海量医学影像数据中查找视觉或语义相似的图像

MedSigLIP作为一个组件,为MedGemma提供了视觉理解能力,其编码性能媲美或超越专业医学图像编码器。

总的来说,谷歌MedGemma系列为医学图文处理提供了基础平台,有望显著加速医学研究及下游应用开发。

感兴趣的读者可以阅读论文原文,了解更多研究内容。

人工智能×[生物神经科学数学物理化学材料]

「ScienceAI」关注人工智能与其他前沿技术及基础科学的交叉研究与融合发展。

欢迎关注标星,并点击右下角点赞和在看。

点击阅读原文,加入专业从业者社区,以获得更多交流合作机会及服务。